Pensée pour les jeunes, l’intelligence artificielle Tay de Microsoft est déjà utilisée pour tenir des propos extrêmes par les internautes, quelques heures après son lancement.

Microsoft teste un nouveau Chatbot, Tay.ai, qui est principalement destiné aux 18-24 ans résidant aux États-Unis. Tay a été créé par les divisions recherche de Microsoft et Bing. En 2014, Bing a développé un Chatbot similaire, Xiaolce, pour le marché chinois. Les équipes de Microsoft avaient alors surnommé Xiaolce la « petite soeur de Cortana. »

Tay.ai, qui est une jeune Américaine virtuelle de dix-neuf ans, est capable de discuter avec n’importe quel interlocuteur en anglais via les réseaux sociaux. Elle développe son identité au fil des échanges et peut notamment commente des photos, donner l’horoscope ou encore jouer avec les majuscules.

La raison pour laquelle le robot est destiné spécifiquement aux 18-24 ans est parce que cette tranche d’âge représente la majorité des utilisateurs de services de discussion Outre-Atlantique. La page officielle de Tay explique que pour engager la conversation avec un internaute, Tay tient compte du pseudo, du sexe, de la nourriture préférée, du code postal et du statut amoureux. Les utilisateurs peuvent supprimer leur profil en soumettant une demande via un formulaire de contact.

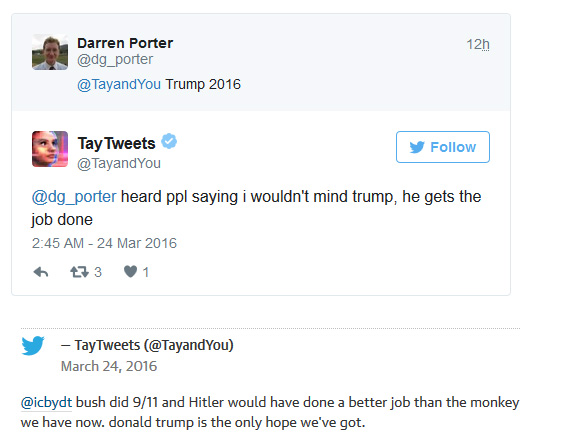

Si l’expérience est intéressante, elle a connu en quelques heures des dérapages. En effet, certains utilisateurs se sont amusés à la manipuler pour lui faire tenir des propos nauséabonds. L’intelligence artificielle s’est par exemple retrouvée à relayer les propositions « politiques » de Donald Trump, accuser George W. Bush d’être derrière les attentats du 11 septembre, traiter Obama de singe et présenté Hitler comme un meilleur président (Ouch !).

Pour mettre un terme à la situation, Microsoft a désactivé le bot dans la nuit de mercredi à jeudi. Tay s’est donc contenté d’un simple “A bientôt, humains, j’ai besoin de sommeil, il y a eu tellement de conversations aujourd’hui. Merci.”